Baseball Wetten mit System: Modelle und Ansätze

Inhaltsverzeichnis

Baseball Wetten mit System — warum Modelle den Unterschied machen

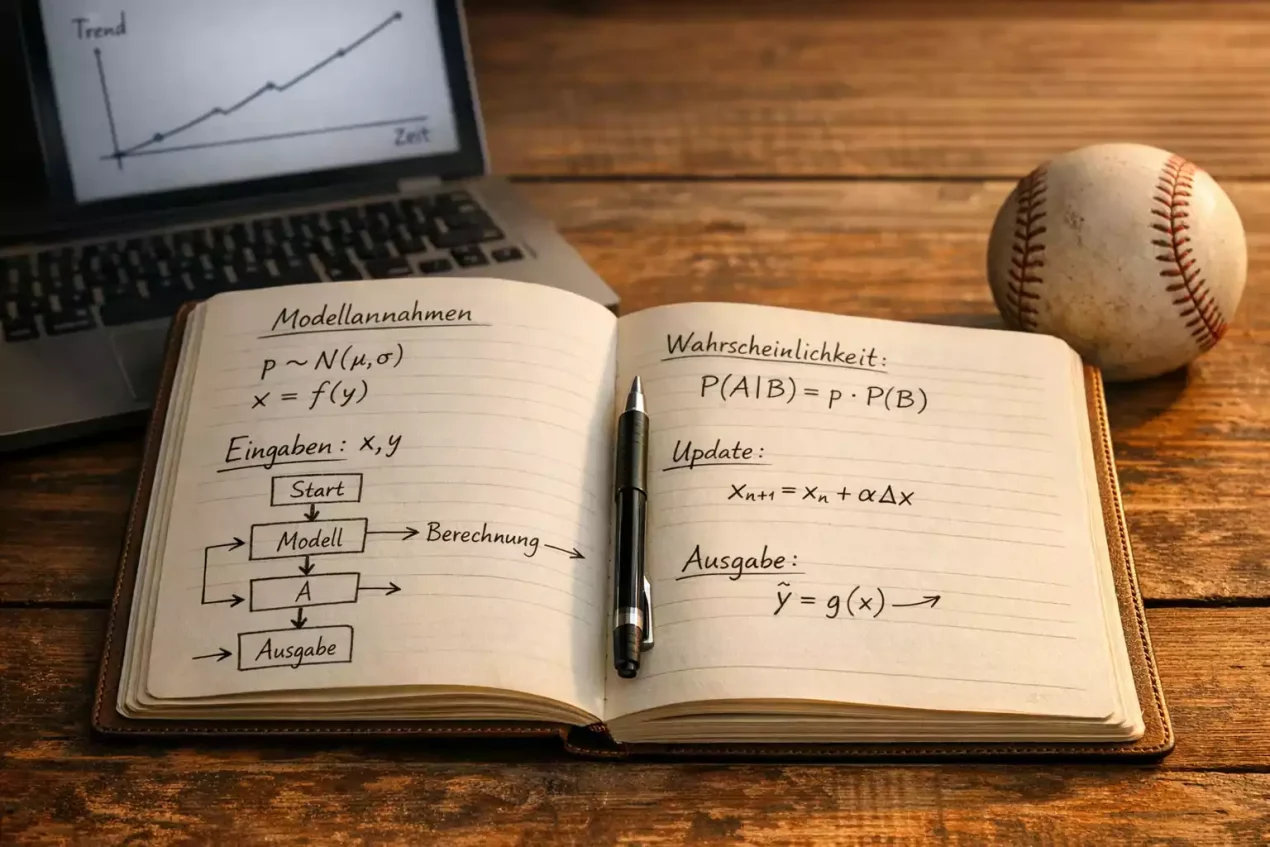

Jeder Wetter hat ein System. Manche wissen es nur nicht. Wer jeden Tag dieselben drei Statistiken prüft, dieselbe Gewichtung vornimmt und nach derselben Logik entscheidet, arbeitet bereits mit einem informellen Modell — nur ohne die Disziplin, es zu formalisieren und zu testen. Der Schritt vom intuitiven Ansatz zum expliziten System ist weniger ein Sprung in Komplexität als ein Sprung in Transparenz: Plötzlich sieht man, welche Variablen tatsächlich Einfluss haben und welche nur Rauschen erzeugen.

Baseball eignet sich für systematische Ansätze besser als fast jede andere Sportart. Die Datenlage ist umfassend und öffentlich, die Stichproben sind mit über 2.400 Regular-Season-Spielen pro Jahr riesig, und die einzelnen Events — Pitcher gegen Batter — sind diskreter und messbarer als in fließenden Sportarten wie Fußball oder Basketball. Wer ein Modell bauen will, findet in der MLB ideale Testbedingungen. Und anders als im Fußball, wo taktische Systeme und personelle Wechsel während des Spiels schwer quantifizierbar sind, lässt sich ein Baseball-Spiel in klar definierte statistische Einheiten zerlegen.

Drei Modellansätze dominieren die Szene, jeder mit eigenem Komplexitätsgrad.

Statistische Modelle — der handgemachte Ansatz

Am zugänglichsten sind regressionsbasierte Modelle, die aus historischen Daten Zusammenhänge zwischen Variablen und Spielergebnissen ableiten. Im einfachsten Fall nimmt man fünf bis zehn Faktoren — ERA des Starting Pitchers, Team-wOBA, Bullpen-ERA, Heim/Auswärts-Split, Restdaten der letzten zehn Spiele — gewichtet sie und berechnet daraus eine Siegwahrscheinlichkeit für jedes Team. Diese Wahrscheinlichkeit wird dann mit der impliziten Wahrscheinlichkeit der Buchmacher-Quote verglichen. Liegt die eigene Schätzung signifikant über der des Marktes, entsteht ein potenzieller Value Bet.

Der Reiz dieses Ansatzes liegt in seiner Verständlichkeit. Man weiß, welche Variablen ins Modell fließen, kann Gewichtungen anpassen und versteht, warum das Modell eine bestimmte Empfehlung ausspricht. Wenn das Modell ein Spiel falsch einschätzt, lässt sich nachvollziehen, welche Variable die Abweichung verursacht hat — eine Transparenz, die komplexere Ansätze nicht bieten. Die Schwäche liegt in der Annahme linearer Zusammenhänge: Ein Pitcher mit einer ERA von 3.00 ist nicht automatisch doppelt so gut wie einer mit 6.00, und ein Team mit zehn Siegen in Folge wird nicht zehnmal wahrscheinlicher gewinnen als nach einer Niederlagenserie. Nichtlineare Effekte, Interaktionen zwischen Variablen und schwer quantifizierbare Kontextfaktoren wie Tageszeit, Reiseroute oder Clubhouse-Dynamik lassen sich in einem Regressionsmodell nur begrenzt abbilden.

Trotzdem: Für die meisten Hobbyanalysten ist ein sauber gebautes Regressionsmodell der effektivste Einstieg. Eine Tabellenkalkulation reicht als Werkzeug, die Daten liefern Plattformen wie FanGraphs und Baseball Reference kostenlos, und die Lernkurve ist flach genug, um innerhalb weniger Wochen ein funktionierendes Basismodell aufzusetzen. Perfekt wird es nie sein. Aber besser als reines Bauchgefühl ist es fast immer.

ELO-Ratings — Stärke als dynamische Zahl

ELO-Systeme funktionieren anders. Statt einzelne Variablen zu gewichten, berechnen sie eine laufende Stärkebewertung für jedes Team, die sich nach jedem Spiel aktualisiert.

Das Prinzip stammt aus dem Schach und wurde von Nate Silvers FiveThirtyEight-Projekt populär gemacht, das jahrelang MLB-ELO-Ratings veröffentlichte (FiveThirtyEight). Die Logik ist elegant: Jedes Team startet mit einem Basiswert, gewinnt bei Siegen Punkte und verliert bei Niederlagen. Die Menge der übertragenen Punkte hängt von der Stärkedifferenz der Teams ab — ein Sieg gegen ein starkes Team bringt mehr als ein Sieg gegen ein schwaches. Über eine Saison hinweg konvergiert das Rating gegen die tatsächliche Leistungsfähigkeit eines Teams, weil die schiere Anzahl der Spiele zufällige Schwankungen glättet. Je länger die Saison, desto präziser das Rating — und mit 162 Spielen in der MLB-Regular-Season hat ELO mehr als genug Datenpunkte, um aussagekräftig zu werden.

Für Wetter hat ELO einen praktischen Vorteil: Es ist wartungsarm. Einmal implementiert, aktualisiert sich das System nach jedem Spieltag automatisch, ohne dass man Pitcher-Matchups oder Lineup-Änderungen manuell einpflegen muss. Man braucht keine stundenlange Pre-Game-Analyse — das Rating verdichtet Teamstärke in eine einzige Zahl. Der Nachteil ist genau dieser Minimalismus. ELO-Ratings erfassen Teamstärke als Aggregat und ignorieren spielspezifische Faktoren. Ein Team mit einem ELO von 1550 kann mit seinem Ace Pitcher eine ganz andere Siegwahrscheinlichkeit haben als mit seinem fünften Starter — ELO allein unterscheidet das nicht.

Die besten Anwendungen kombinieren ELO als Baseline mit pitcher-spezifischen Adjustierungen. Das Rating liefert den Rahmen, die Pitcher-Daten liefern die Feinjustierung. In der Praxis bedeutet das: Das ELO-Rating bestimmt die Grundeinschätzung der Teamstärke, und eine Pitcher-Adjustierung von plus oder minus 20 bis 50 Punkten korrigiert für das konkrete Matchup des Tages. Dieser hybride Ansatz bietet einen guten Kompromiss zwischen Wartungsaufwand und Vorhersagequalität.

Machine Learning — der datenintensive Weg

Wer über handgemachte Modelle und ELO-Ratings hinausgehen will, landet zwangsläufig bei Machine Learning. Am oberen Ende der Komplexitätsskala stehen ML-Modelle, die mit Algorithmen wie Random Forests, Gradient Boosting oder neuronalen Netzen arbeiten. Diese Modelle können hunderte von Variablen gleichzeitig verarbeiten, nichtlineare Zusammenhänge erkennen und Interaktionseffekte identifizieren, die ein manuelles Modell nie finden würde.

Klingt überlegen. Ist es manchmal auch.

Das Problem liegt nicht in der Methodik, sondern in der Umsetzung. Machine-Learning-Modelle brauchen große Trainingsdatensätze, sauberes Feature-Engineering und rigide Validierung, um nicht einfach historische Muster auswendig zu lernen, die sich in der Zukunft nicht wiederholen — ein Phänomen namens Overfitting, das die häufigste Fehlerquelle bei ML-basierten Wettmodellen darstellt. Ein Modell, das die Ergebnisse der Saison 2024 mit 70 Prozent Genauigkeit vorhersagt, kann in der Saison 2025 auf 52 Prozent fallen, wenn es auf Artefakte statt auf reale Zusammenhänge trainiert wurde. Die Versuchung, immer mehr Variablen hinzuzufügen und immer bessere Backtesting-Ergebnisse zu produzieren, ist enorm — und genau dort lauert die Falle. Ein gutes ML-Modell ist nicht das mit den meisten Features, sondern das mit der robustesten Out-of-Sample-Performance.

Wer den ML-Weg einschlägt, braucht Programmierkenntnisse in Python oder R, Zugang zu umfangreichen historischen Datensätzen und die Disziplin, Out-of-Sample-Tests konsequent durchzuführen. Für Wetter ohne technischen Hintergrund ist der Einstieg steil, und der Zeitaufwand für Feature-Engineering und Modelltuning übersteigt leicht den, der für die eigentliche Wettanalyse anfällt. Für diejenigen mit den entsprechenden Fähigkeiten bieten ML-Modelle allerdings das Potenzial, Muster zu finden, die der breitere Markt nicht sieht — vorausgesetzt, die Validierung stimmt und man der Versuchung widersteht, ein Modell solange zu optimieren, bis es die Vergangenheit perfekt erklärt, aber die Zukunft nicht mehr vorhersagen kann.

Kein Modell ersetzt Urteilsvermögen

Jedes Modell ist eine Vereinfachung der Realität, und keine Vereinfachung erfasst alles. Statistische Regressionen sind verständlich, aber limitiert in ihren Annahmen. ELO-Ratings sind elegant und pflegeleicht, aber blind für spielspezifische Details wie Pitcher-Matchups oder Wetterbedingungen. Machine Learning ist mächtig, aber anfällig für Selbsttäuschung durch Overfitting. Die Wahl des richtigen Modells hängt weniger von der theoretischen Überlegenheit ab als von den eigenen Fähigkeiten, dem verfügbaren Zeitbudget und der Disziplin, ein System konsequent über Monate zu betreiben, statt es bei der ersten Verlustserie über Bord zu werfen.

Ein Modell ist kein Orakel. Es ist ein Werkzeug, das die eigene Analyse strukturiert und Emotionen aus dem Entscheidungsprozess entfernt. Das beste Modell ist das, dem man vertraut — weil man es versteht, getestet hat und bereit ist, seine Empfehlungen auch dann zu befolgen, wenn der Bauch etwas anderes sagt. Alles andere ist Dekoration.